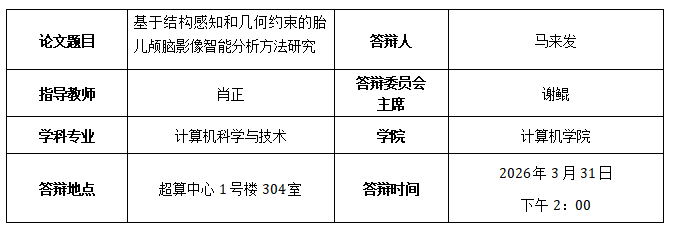

学位论文简介

本文立足临床实际需求,聚焦胎儿颅脑的智能影像分析,围绕结构自动分割与三维重建两大核心任务展开系统研究。提出了融合结构感知、解剖一致性约束和几何约束优化的创新方法,旨在从二维分割到三维重建的完整技术路径,实现胎儿颅脑结构的精准识别与高分辨率三维重建,为胎儿颅脑发育评估与产前异常诊断提供可靠的技术支撑。具体贡献如下:

(1)针对产前胎儿颅脑超声结构分割中现有基于学习方法对微小结构分割不准、覆盖结构有限等问题,本文提出一种结构感知的胎儿颅脑超声结构细粒度分割框架。具体而言,提出了结构感知候选框重叠度度量方法。基于该方法,设计了改进的非极大值抑制算法。此外,设计了一种具有更大感受野的精细化分割头,以充分保留关键解剖信息并增强局部结构细节表达。

(2)针对现有胎儿超声颅脑结构自动分割方法普遍忽视脑部结构全局解剖关系与空间一致性、易导致分割结果出现边界模糊和结构断裂的问题,本文提出一种基于解剖一致性约束的分割架构。该架构首先设计空间金字塔 RoIAlign 分割头;其次,为进一步保证分割结果的形态一致性与解剖合理性,提出了解剖形状先验约束自编码器,确保预测掩码在形态上符合解剖学先验。

(3) 针对胎儿颅脑MRI采集过程中的胎儿不规则运动会导致结构连续性的丧失和三维信息被破坏问题,本文提出了一种基于几何约束的三维 MRI 图像重建方法。提出一种几何约束深度学习模型,用于预测胎儿颅脑 MRI 二维切片的任意运动参数,设计了基于残差的编码器-解码器网络,结合感知损失与对抗损失以增强细节重建能力,从而获得更真实、自然的重建三维图像。

(4)针对现有产前胎儿颅脑三维图像重建方法中运动参数估计不稳定、重建精度不足的问题,本文提出一种基于提示引导的卷积神经网络(CNN)与 Transformer 混合架构的三维图像重建方法。该方法采用粗到精的双阶段运动校正策略,实现局部特征建模与全局上下文感知的协同。在此基础上,结合点扩散函数实现初始三维图像重建和异常切片剔除;进一步提出基于隐式神经表示的高分辨率三维图像重建模型。

主要学术成果

[1] L. Ma, G. Tan, H. Luo, Q. Liao, S. Li, and K. Li, “A novel deep learning framework for automatic recognition of thyroid gland and tissues of neck in ultrasound image”, IEEE Transactions on Circuits and Systems for Video Technology, vol. 32, no. 9, pp. 6113–6124, 2022.

[2] L. Ma, Z. Xiao, K. Li, S. Li, J. Li, and X. Yi, “Game theoretic interpretability for learning based preoperative gliomas grading”, Future Generation Computer Systems, vol. 112, pp. 1–10, 2020.

[3] L. Ma, K. Li, Z. Xiao, G. Tan, H. Wen, and S. Li, “Structure-aware fine-grained instance segmentation for fetal brain ultrasound images,” Neurocomputing, p. 133093, 2026.

[4] L. Ma, L. Chen, F. Zhao, Z. Wu, L. Wang, W. Lin, H. Zhang, K. Li, and G. Li, “Geometric constrained deep learning for motion correction of fetal brain MR images”, in Proceedings of the IEEE International Symposium on Biomedical Imaging, 2023, pp. 1–5.

[5] L. Ma, W. Lin, H. Zhang, and G. Li, “Automated fetal brain volume reconstruction from motion-corrupted stacks with deep learning”, in Proceedings of the IEEE International Symposium on Biomedical Imaging, 2024, pp. 1–5.