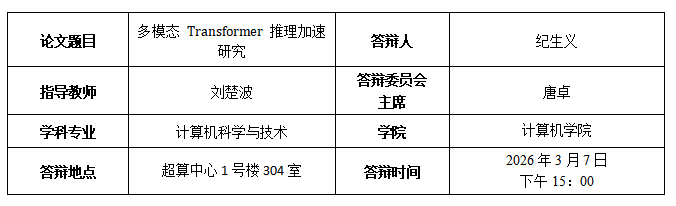

学位论文简介

本论文面向多模态 Transformer 模型的高效推理需求,针对其在有效计算占比、数据访问开销以及GPU在线调度等方面存在的关键挑战,提出了计算冗余削减、数据移动开销降低以及GPU在线调度优化的解决方案,并通过端到端实验验证其有效性。主要工作内容和创新点如下:

(1) 针对冗余计算影响推理速度的问题,提出基于指令引导的推理加速技术。本文构建了 IGMLLM 框架,将注意力剪枝、指令语义分组、差分嵌入注意力与置信度提前退出等技术进行协同设计,实现了在无额外训练条件下的推理效率提升。同时,面向动态与非规则计算特性设计了专用 IGMLLM 加速器,以支撑 IGMLLM 框架的高效执行。实验结果表明,IGMLLM 在多个视觉语言基准上将精度损失控制在 1.5% 以内,实现了相较 GPU 的最高 16.5倍端到端加速与 24.6倍能效提升。

(2) 针对数据移动限制推理速度的问题,提出基于存内计算(PIM)-GPU 协同优化的推理加速技术。本文以矩阵运算为核心卸载对象,首先在系统层面通过动态规划实现了 PIM 与 GPU 间的负载均衡,其次引入了变长感知优化以降低变长输入下的空间碎片,最后扩展了编译后端实现 PIM 与 GPU 内核并行启动与统一部署。实验结果表明,该协同推理框架对多模态 Transformer 推理加速的效果显著。

(3) 针对调度机制制约推理速度的问题,提出基于多 GPU 并行优化的推理加速技术。本文设计了一种可观测的 GPU 内核级调度器,实现跨请求 GPU 内核交错执行与快速资源回收以降低队头阻塞风险。首先,通过线程块粒度的进度反馈将 GPU 执行过程由不可观测转化为可观测。其次,引入时延反馈驱动的最短剩余处理时间近似机制,采用指数加权移动平均实现在线自适应校准。然后,面向多 GPU 张量并行推理,构建主从式同步调度架构以保证跨 rank 的内核调度顺序一致。最后,提出将视觉编码与预填充融合阶段(Vision Encode+Prefill, EP)与解码阶段(Decode, D)解耦的 EP+D 并行策略,以适配不同阶段的瓶颈差异。实验结果表明,本方法吞吐量达到请求级调度方法的 1.85 倍,验证了优化方案的有效性。

主要学术成果

学术论文:

[1] Shengyi Ji, Chubo Liu, Yan Ding, Qing Liao, Zhuo Tang. A Real-time Execution System of Multimodal Transformer through PIM-GPU Collaboration[C]//Proceedings of the 61st ACM/IEEE Design Automation Conference. 2024: 1-6. (第一作者,CCF A类会议)

[2] Peng Peng, Shengyi Ji, M. Tamer Özsu & Lei Zou. Minimum motif-cut: a workload-aware RDF graph partitioning strategy[J]. The VLDB Journal, 2024, 33(5): 1517-1542. (导师一作本人二作,CCF A类期刊)

[3] Peng Peng, Shengyi Ji, Zhen Tian, Hongbo Jiang, Weiguo Zheng, Xuecang Zhang. Locality Sensitive Hashing for Optimizing Subgraph Query Processing in Parallel Computing Systems[C]//Proceedings of the 29th ACM SIGKDD Conference on Knowledge Discovery and Data Mining. 2023: 1885-1896. (导师一作本人二作,CCF A类会议)

[4] Shengyi Ji, Peng Peng, Jian Hu, Lei Zou, Zhen Huang & Zheng Qin. PEG: a partial evaluation-based distributed RDF graph system[C]//International Conference on Database Systems for Advanced Applications. Cham: Springer Nature Switzerland, 2023: 658-662.(第一作者,CCF B类会议)

[5] Shengyi Ji, Yan Ding, Haotian Wang, Chubo Liu, Wanli Chang, Leilei Lou, Kenli Li. IGMLLM: Instruction-Guided Efficient Acceleration for Multimodal Large Language Models. Proceedings of the 63st ACM/IEEE Design Automation Conference. 2026. (第一作者,CCF-A类会议,在审)